Deepfakes: Jede beliebige Identität kann gekidnappt werden

Nach einem Interview mit Steve Jobs, gestaltet von KI, nehmen mahnende Stimmen zu. IT-Spezialistin Nina Schick warnt vor einer „großen Bedrohung“ durch die Technologie.

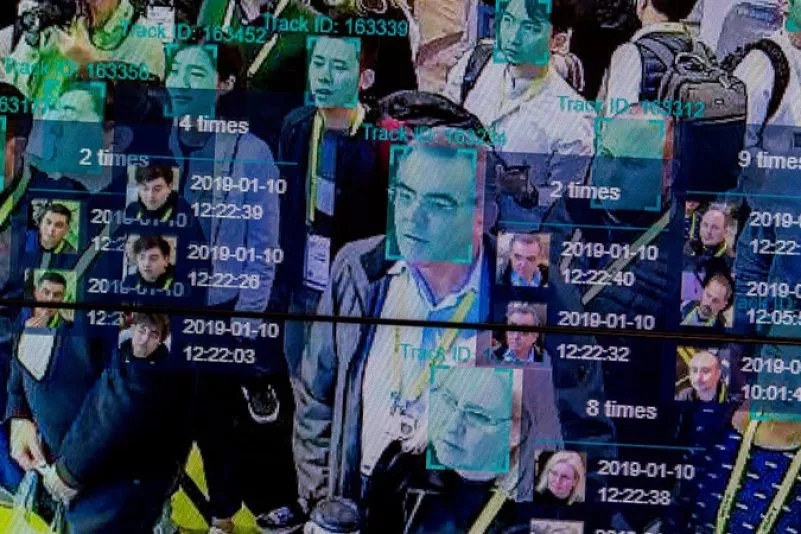

Künstliche Intelligenz und Gesichtserkennung in einer dichten Menschenmenge.

Foto: David McNew/AFP via Getty Images

Die Idee ist eine uralte. Schon vor Jahrzehnten war es beliebt, Fotos verschiedener Personen zu nehmen, einzelne Körperteile auszuschneiden und sie auszutauschen. Auf diesen Collagen hatte Oma dann den Kopf des Enkels, der wiederum die Ohren von Onkel Erwin hatte. Der Fantasie waren keine Grenzen gesetzt. Doch blieb es nicht beim familiären Vergnügen. Vor allem rasant voranschreitende technische Entwicklungen boten die Möglichkeiten, falsche Situationen zu schaffen und andere Menschen in Schwierigkeiten zu bringen.

Steve Jobs 2022

Mit Beginn des Internetzeitalters wichen Schere und Klebstoff Computerprogrammen. Es wurde begonnen, Köpfe von Promis (fast) perfekt auf entblößte Körper zu montieren. Diese Fakefotos kursieren wahrscheinlich für alle Zeiten im Netz, während die Technik mittlerweile einen Grad der Perfektion erreicht hat, sodass Fälschungen praktisch nicht mehr erkennbar sind.

Dabei steht den Produzenten die Künstliche Intelligenz (KI) zur Verfügung, mit der sie sogenannte Deepfakes kreieren können. Deepfakes sind realistisch wirkende Fotos, Videos oder Tonaufnahmen, die mithilfe der KI-Techniken verändert werden. Dabei nutzen Deepfakes künstliche neuronale Netzwerke, um Fälschungen weitgehend autonom zu erzeugen.

Für Schlagzeilen sorgte im Frühsommer ein falscher Vitali Klitschko, der bei den Bürgermeistern von Berlin, Wien und Madrid angerufen hatte. Für einiges Aufsehen sorgte auch ein „Interview“ zwischen dem amerikanischen Podcaster Joe Rogan und dem Apple-Mitgründer Steve Jobs, über das die „Bild“ berichtete.

Dabei analysierte ein Computer Material, das er über den 2011 verstorbenen Jobs und Rogan im Internet gefunden hatte, schrieb das Skript und imitierte die Stimmen der beiden Männer. Während des etwa 20-minütigen frei erfundenen „Gesprächs“ redet „Jobs“ über den Erfolg seiner Firma, Buddhismus und Drogenkonsum.

Jede beliebige Identität kann gekidnappt werden

Die IT-Spezialistin Nina Schick sieht eine „große Bedrohung“ durch die Technologie, sagte sie der österreichischen Zeitung „Der Standard“ im Interview. Obwohl es sich beim Klitschko-Fake nicht um den Einsatz von KI gehandelt habe, sei der Vorfall beispielhaft dafür, „dass im heutigen digitalen Ökosystem jede beliebige Identität gekidnappt werden kann“.

Deepfake durch KI sei die größte Gefahr für die Unversehrtheit der Persönlichkeitsrechte. Den Ukraine-Krieg nannte Nina Schick beispielhaft für sogenannte „hybride Kriege“. Es werde nicht nur mit konventionellen Waffen gekämpft, sondern auch mit Informationen.

Deepfake kommt bisher in Kriegen noch nicht im großen Stil zum Einsatz: „Ich bin aber überzeugt, dass das in Zukunft stattfinden wird. Wenn wir uns vorstellen, wie destruktiv bereits konventionelle Fake News sein können, wie schlimm wird das erst mit Deepfake werden?“

Was sind Fakten, was ist Fiktion?

Diese Sorgen teilt auch Eric Horvitz, Chief Science Officer von Microsoft. Die Fortschritte im Bereich der KI ermöglicht es Akteuren, überzeugende Desinformationen zu erstellen und zu verbreiten, schreibt er in seinem Forschungspapier mit dem Titel „On the Horizon: Interactive and Compositional Deepfakes“.

Horvitz fürchtet, „dass sich unsere Kinder und Enkelkinder in einer post-epistemischen Welt wiederfinden könnten“. Es sei für sie dann schwierig oder unmöglich, Fakten von Fiktion zu unterscheiden.

Es sei Wachsamkeit geboten, wenn es um die potenzielle Nutzung von Daten und Technologien für Desinformation gehe, schlussfolgert Horvitz. „Wir müssen den möglichen Missbrauch der von uns geschaffenen Technologien ins Auge fassen und an der Entwicklung von Sicherheitsvorkehrungen arbeiten.“

Aktuelle Artikel des Autors

12. November 2022

Digitales Geld als Wachstumsbeschleuniger angepriesen

8. November 2022

Grünes Licht für Weichenstellung in ein neues Zeitalter

4. November 2022

Dem Volk den Mund verbieten

Kommentare

Noch keine Kommentare – schreiben Sie den ersten Kommentar zu diesem Artikel.

0

Kommentare

Noch keine Kommentare – schreiben Sie den ersten Kommentar zu diesem Artikel.