Geheimdienst-Alarm: Ausländische Mächte nutzen KI zur Manipulation der US-Wähler

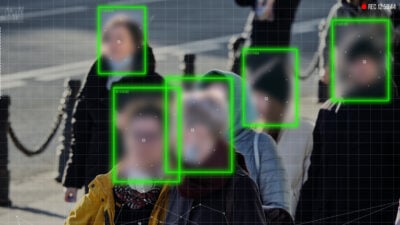

Mächte außerhalb der USA setzen zunehmend künstliche Intelligenz (KI) ein, um das Wahlverhalten der US-Amerikaner zu beeinflussen. Zu diesem Schluss kommt ein neuer Geheimdienstbericht, der nur 45 Tage vor den US-Präsidentschaftswahlen veröffentlicht wurde.

Das Büro des Direktors der nationalen Nachrichtendienste (ODNI) veröffentlichte am Montag, 23. September, ein Sicherheitsupdate, das vor China, dem Iran und Russland warnt. Diese würden ihre Aktivitäten verstärken, um die öffentliche Meinung in den Vereinigten Staaten mithilfe von KI-Werkzeugen zu beeinflussen.

Schon Anfang September hatten US-Geheimdienste darauf hingewiesen, dass ausländische Akteure versuchten, die gesellschaftlichen Spaltungen zu verschärfen und die Wähler zu beeinflussen.

Im Update dieser Woche heißt es nun, dass die Akteure wahrscheinlich davon ausgehen, dass die Verstärkung kontroverser Themen und spaltender Rhetorik ihren Interessen dienen könnte. Sie glaubten, dass sie so die USA und das demokratische System als schwach erscheinen lassen und die Aufmerksamkeit der US-Regierung auf interne Probleme lenken könnten, anstatt ihr eigenes feindseliges Verhalten zurückzudrängen.

Zu den Bemühungen ausländischer Mächte gehörten das Einschleusen irreführender Inhalte durch prominente Persönlichkeiten und die Veröffentlichung erfundener „Leaks“, die kontrovers erscheinen sollen. Während KI dazu beigetragen hat, bestimmte Aspekte ausländischer Einflussnahme auf die Vereinigten Staaten zu beschleunigen, stellen die Geheimdienste fest, dass KI diese Taktiken bislang nicht revolutioniert hat.

Länderspezifische Strategien

Während Chinas Aktivitäten eher allgemeiner Natur waren, nutzten der Iran und Russland KI, um Inhalte zu erstellen, die in direktem Zusammenhang mit den US-Wahlen stehen.

Russland soll die meisten KI-Inhalte im Kontext der US-Wahlen generiert haben. Moskaus Bemühungen erstreckten sich auf Text-, Bild-, Audio- und Videomedien. Zu den Aktionen des Kremls gehörten laut Geheimdiensten die Verbreitung verschwörerischer Narrative und KI-generierter Inhalte prominenter US-Persönlichkeiten. Sie zielten darauf ab, die Gräben in Fragen wie der Einwanderung zu vertiefen.

Der Iran hingegen setze KI ein, um Social-Media-Beiträge und nicht authentische Nachrichtenartikel für Websites zu generieren, die sich als legitime Nachrichtenquellen ausgeben. Solche Inhalte sollen sowohl auf Englisch als auch auf Spanisch erscheinen. Sie seien auf amerikanische Wähler aus dem gesamten politischen Spektrum ausgerichtet und konzentrierten sich insbesondere auf umstrittene Themen wie den Israel-Gaza-Konflikt und die US-Präsidentschaftskandidaten.

Dem Bericht zufolge konzentriere sich Chinas Einsatz von KI bei seinen Einflussnahmeoperationen in erster Linie darauf, die globale Wahrnehmung Chinas zu formen und spaltende politische Themen in den USA zu verstärken. Die Operationen zielten nicht direkt auf die US-Wahlen.

Chinesische Akteure hätten auch KI-generierte Inhalte wie gefälschte Nachrichtensprecher und Social-Media-Profile eingesetzt, um innenpolitische Themen in den USA wie Drogenkonsum, Einwanderung und Abtreibung zu verstärken, ohne dabei ausdrücklich einen Kandidaten zu unterstützen.

In ihrem Sicherheitsupdate zur Wahl vom 6. September erklärten die US-Geheimdienste, dass China sich zu diesem Zeitpunkt hauptsächlich darauf konzentrierte, die Wahl der Kandidaten für die untergeordneten Ämter zu beeinflussen, und sich noch nicht mit der US-Präsidentschaftswahl befasste.

Wahrnehmung im Fokus

Das Ziel der ausländischen Akteure sei es nach wie vor, die Wahrnehmung zu beeinflussen, anstatt sich direkt in den eigentlichen Wahlprozess einzumischen, heißt es im jüngsten Bericht.

Die Geheimdienste warnen davor, dass Gegner mit dem Näherrücken des Wahltages wahrscheinlich weiterhin verstärkt KI-gesteuerte Desinformationskampagnen durchführen werden, was ein Risiko für die demokratischen Prozesse in den USA darstelle.

Im März berichtete die Epoch Times über den zunehmenden Einfluss politischer Memes (ironischer Bildwitze) auf den Wahldiskurs. Damals erklärte Pamela Rutledge, Direktorin des Media Psychology Research Center, gegenüber der Epoch Times, dass Deepfakes – realistische Bilder, Videos und Audiodateien, die in der Regel von generativer KI-Software erstellt werden – Menschen effektiv täuschen können und dies auch täten.

Rutledge sagte, dass die Botschaften selbst dann überzeugend sein könnten, wenn der Inhalt offensichtlich gefälscht oder von geringer Qualität sei, solange sie die politischen Vorurteile der Menschen bestätigten.

Eine im Mai vom Imagining the Digital Future Center der Elon University in North Carolina veröffentlichte Umfrage ergab, dass 78 Prozent der Amerikaner glauben, dass die Präsidentschaftswahlen durch „korrupte Machenschaften“ im Zusammenhang mit KI-generierten Inhalten, die sich in den sozialen Medien verbreiten, beeinflusst werden.

„Viele sind sich nicht sicher, ob sie den Müll, von dem sie wissen, dass er kampagnenbezogene Inhalte verschmutzt, aussortieren können“, sagte Lee Rainie, Direktor des Digital Future Center, in einer Erklärung.

Als Beweis für die möglichen Auswirkungen von KI-generiertem Inhalt auf Wahlen gaben rund drei Viertel der Umfrageteilnehmer dem Zentrum gegenüber an, dass sie nicht glauben, dass die meisten Wähler zwischen gefälschten und authentischen Fotos, Audio- und Videoinhalten unterscheiden können.

Dieser Artikel erschien im Original auf theepochtimes.com unter dem Titel „China, Iran, Russia Using AI to Influence US Elections, Intelligence Community Warns“. (deutsche Bearbeitung jw)

vielen Dank, dass Sie unseren Kommentar-Bereich nutzen.

Bitte verzichten Sie auf Unterstellungen, Schimpfworte, aggressive Formulierungen und Werbe-Links. Solche Kommentare werden wir nicht veröffentlichen. Dies umfasst ebenso abschweifende Kommentare, die keinen konkreten Bezug zum jeweiligen Artikel haben. Viele Kommentare waren bisher schon anregend und auf die Themen bezogen. Wir bitten Sie um eine Qualität, die den Artikeln entspricht, so haben wir alle etwas davon.

Da wir die Verantwortung für jeden veröffentlichten Kommentar tragen, geben wir Kommentare erst nach einer Prüfung frei. Je nach Aufkommen kann es deswegen zu zeitlichen Verzögerungen kommen.

Ihre Epoch Times - Redaktion